Możliwość zastosowania i użyteczność modeli Machine Learning jest testowana na danych. Wiarygodność testów w dużej mierze zależy od ilości i jakości danych, na których zastosowano te modele. Utworzenie, uzyskanie i oczyszczenie odpowiednio dużego zbioru danych w celu przetestowania „ Przetwarzanie języka naturalnego (NLP) „Model uczenia maszynowego.

Hugging Face oferuje na to zgrabne rozwiązanie dzięki wyjątkowo dużej bibliotece zbiorów danych do wyboru i znalezienia tego, który idealnie odpowiada Twoim wymaganiom. Tutaj pokażemy Ci, jak znaleźć idealny zbiór danych i przygotować go do odpowiedniego przetestowania modelu.

Jak korzystać ze zbiorów danych obejmujących twarze przytulające?

Pokażemy Ci, jak korzystać ze zbiorów danych Hugging Face na przykładzie „ Małe Historie Zbiór danych z Hugging Face.

Przykład

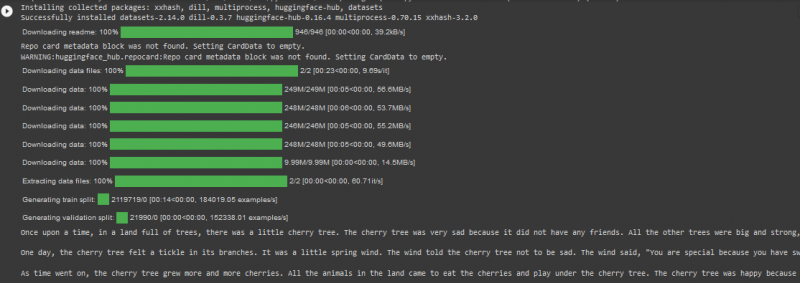

Zbiór danych TinyStories zawiera ponad 2 miliony wierszy danych w podziale na pociągi i ma ponad 2 tysiące pobrań na platformie Hugging Face. Wykorzystamy go w kodzie w Google Colab podanym poniżej:

! pypeć zainstalować transformatory

! pypeć zainstalować zbiory danych

ze zbiorów danych zaimportuj zbiór danych_load_dataset

zbiór danych = zbiór_danych ładowania ( „ronneneldan/TinyStories” )

TinyStories_Story = 3

przykład_string = zbiór danych [ 'pociąg' ] [ TinyStories_Story ] [ 'tekst' ]

wydrukować ( przykład_ciąg )

W tym kodzie rozważ poniższe kroki:

Krok 01 : Pierwszym krokiem jest „ instalacja ”zestawów danych transformatorów.

Krok 02 : Następnie zaimportuj wymagany zestaw danych, „ Małe Historie ”w swoim projekcie.

Krok 03 : Następnie załaduj wybrany zestaw danych za pomocą przycisku „ załaduj_dataset() ”funkcja.

Krok 04 : Teraz określamy numer historii, którą chcemy ze zbioru danych TinyStories. W naszym przykładzie kodu określiliśmy liczbę 03.

Krok 05 : Na koniec użyjemy metody „print()”, aby wyświetlić wynik.

Wyjście

Notatka: Kod i dane wyjściowe można również wyświetlić bezpośrednio w naszym Google Colab .

Wniosek

„ Zbiory danych Hugging Face ” sprawiają, że testowanie modeli uczenia maszynowego przy jednoczesnym bezpośrednim importowaniu dużych zbiorów danych z biblioteki online jest niezwykle wydajne dla użytkowników. W rezultacie stosowanie algorytmów NLP stało się łatwiejsze i szybsze, ponieważ programiści mogą testować swoje projekty na podstawie zbioru danych, który ma zarówno jakość, jak i ilość.