Biblioteka „zestawów danych” firmy Hugging Face zapewnia wygodny sposób pracy i manipulowania zbiorami danych na potrzeby zadań związanych z przetwarzaniem języka naturalnego. Jedną z przydatnych funkcji oferowanych przez bibliotekę jest concatenate_datasets(), która umożliwia połączenie wielu zestawów danych w jeden zestaw danych. Poniżej znajduje się krótki przegląd funkcji concatenate_datasets() i sposobu jej używania.

concatenate_datasets()

Opis:

Biblioteka „zestawów danych” Hugging Face udostępnia funkcję concatenate_datasets(). Służy do łączenia wielu zbiorów danych w jeden zbiór danych wzdłuż określonej osi. Ta funkcja jest szczególnie przydatna, gdy masz wiele zbiorów danych o tej samej strukturze i chcesz połączyć je w ujednolicony zbiór danych w celu dalszego przetwarzania i analizy.

Składnia:

z zbiory danych import concatenate_datasets

połączony_zestaw_danych = concatenate_datasets ( zbiory danych , oś = 0 , informacje = Nic )

Parametry:

zbiory danych (lista zestawu danych): lista zestawów danych, które chcesz połączyć. Te zbiory danych powinny mieć kompatybilne funkcje, co oznacza, że mają ten sam schemat, nazwy kolumn i typy danych.

oś (int, opcjonalnie, default=0): Oś, wzdłuż której należy wykonać konkatenację. W przypadku większości zbiorów danych NLP używana jest domyślna wartość 0, co oznacza, że zbiory danych są łączone w pionie. Jeśli ustawisz oś = 1, zbiory danych zostaną połączone poziomo, zakładając, że mają różne kolumny jako cechy.

informacje (datasets.DatasetInfo, opcjonalnie): Informacje o połączonym zestawie danych. Jeśli nie zostaną podane, informacje zostaną wywnioskowane z pierwszego zestawu danych na liście.

Zwroty:

połączony_zestaw_danych (Zbiór danych): Wynikowy zbiór danych po połączeniu wszystkich wejściowych zbiorów danych.

Przykład:

# Krok 1: Zainstaluj bibliotekę zestawów danych# Możesz go zainstalować za pomocą pip:

# !pip zainstaluj zestawy danych

# Krok 2: Zaimportuj wymagane biblioteki

z zbiory danych import ładowanie_zestawu danych , concatenate_datasets

# Krok 3: Załaduj zestawy danych recenzji filmów IMDb

# Wykorzystamy dwa zbiory danych IMDb, jeden dla pozytywnych recenzji

#i kolejny za negatywne recenzje.

# Załaduj 2500 pozytywnych recenzji

poz_zestawu danych = ładowanie_zestawu danych ( „imdb” , podział = „pociąg [:2500]” )

# Załaduj 2500 negatywnych recenzji

zbiór_danych_neg = ładowanie_zestawu danych ( „imdb” , podział = „pociąg [-2500:]” )

# Krok 4: Połącz zbiory danych

# Łączymy oba zbiory danych wzdłuż osi = 0, tak jak to ma miejsce

ten sam schemat ( te same cechy ) .

połączony_zestaw_danych = concatenate_datasets ( [ poz_zestawu danych , zbiór_danych_neg ] )

# Krok 5: Przeanalizuj połączony zbiór danych

# Dla uproszczenia policzmy liczbę dodatnich i ujemnych

# recenzji w połączonym zbiorze danych.

liczba_pozytywnych_recenzji = suma ( 1 Do etykieta W

połączony_zestaw_danych [ 'etykieta' ] Jeśli etykieta == 1 )

liczba_negatywnych_recenzji = suma ( 1 Do etykieta W

połączony_zestaw_danych [ 'etykieta' ] Jeśli etykieta == 0 )

# Krok 6: Wyświetl wyniki

wydrukować ( „Liczba pozytywnych recenzji:” , liczba_pozytywnych_recenzji )

wydrukować ( „Liczba negatywnych recenzji:” , liczba_negatywnych_recenzji )

# Krok 7: Wydrukuj kilka przykładowych recenzji z połączonego zbioru danych

wydrukować ( ' \N Kilka przykładowych recenzji:” )

Do I W zakres ( 5 ) :

wydrukować ( F „Recenzja {i + 1}: {concatenate_dataset['text'][i]}” )

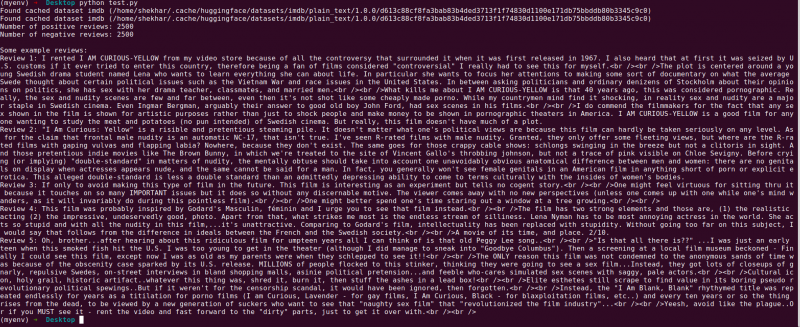

Wyjście:

Poniżej znajduje się wyjaśnienie programu bibliotecznego „zestawów danych” Hugging Face, który łączy dwa zbiory danych recenzji filmów IMDb. Wyjaśnia to cel programu, jego użycie i kroki związane z kodem.

Podajmy bardziej szczegółowe wyjaśnienie każdego kroku w kodzie:

# Krok 1: Zaimportuj wymagane bibliotekiz zbiory danych import ładowanie_zestawu danych , concatenate_datasets

W tym kroku importujemy niezbędne biblioteki do programu. Potrzebujemy funkcji „load_dataset”, aby załadować zestawy danych recenzji filmów IMDb, oraz funkcji „concatenate_datasets”, aby je później połączyć.

# Krok 2: Załaduj zestawy danych recenzji filmów IMDb# Załaduj 2500 pozytywnych recenzji

poz_zestawu danych = ładowanie_zestawu danych ( „imdb” , podział = „pociąg [:2500]” )

# Załaduj 2500 negatywnych recenzji

zbiór_danych_neg = ładowanie_zestawu danych ( „imdb” , podział = „pociąg [-2500:]” )

Tutaj używamy funkcji „load_dataset”, aby pobrać dwa podzbiory zbioru danych IMDb. „dataset_pos” zawiera 2500 pozytywnych recenzji, a „dataset_neg” zawiera 2500 negatywnych recenzji. Używamy parametru split, aby określić zakres przykładów do załadowania, co pozwala nam wybrać podzbiór całego zbioru danych.

# Krok 3: Połącz zbiory danychpołączony_zestaw_danych = concatenate_datasets ( [ poz_zestawu danych , zbiór_danych_neg ] )

Na tym etapie łączymy dwa podzbiory zbioru danych IMDb w jeden zbiór danych o nazwie „concatenated_dataset”. Używamy funkcji „concatenate_datasets” i przekazujemy ją wraz z listą zawierającą dwa zbiory danych do połączenia. Ponieważ oba zbiory danych mają te same cechy, łączymy je wzdłuż osi = 0, co oznacza, że wiersze są ułożone jeden na drugim.

# Krok 4: Przeanalizuj połączony zbiór danychliczba_pozytywnych_recenzji = suma ( 1 Do etykieta W

połączony_zestaw_danych [ 'etykieta' ] Jeśli etykieta == 1 )

liczba_negatywnych_recenzji = suma ( 1 Do etykieta W

połączony_zestaw_danych [ 'etykieta' ] Jeśli etykieta == 0 )

Tutaj przeprowadzamy prostą analizę połączonego zbioru danych. Do zliczania pozytywnych i negatywnych recenzji używamy wyrażeń listowych wraz z funkcją „suma”. Iterujemy poprzez „ label” w kolumnie „concatenated_dataset” i zwiększaj liczbę za każdym razem, gdy napotkamy etykietę dodatnią (1) lub etykietę ujemną (0).

# Krok 5: Wyświetl wynikiwydrukować ( „Liczba pozytywnych recenzji:” , liczba_pozytywnych_recenzji )

wydrukować ( „Liczba negatywnych recenzji:” , liczba_negatywnych_recenzji )

Na tym etapie drukujemy wyniki naszej analizy – liczbę pozytywnych i negatywnych recenzji w połączonym zbiorze danych.

# Krok 6: Wydrukuj kilka przykładowych recenzjiwydrukować ( ' \N Kilka przykładowych recenzji:” )

Do I W zakres ( 5 ) :

wydrukować ( F „Recenzja {i + 1}: {concatenate_dataset['text'][i]}” )

Na koniec prezentujemy kilka przykładowych recenzji z połączonego zbioru danych. Przeglądamy pierwsze pięć przykładów w zbiorze danych i drukujemy ich treść tekstową, korzystając z kolumny „tekst”.

Ten kod demonstruje prosty przykład wykorzystania biblioteki „zestawów danych” Hugging Face do ładowania, łączenia i analizowania zbiorów danych recenzji filmów IMDb. Podkreśla zdolność biblioteki do usprawnienia obsługi zbiorów danych NLP i ukazuje jej potencjał w zakresie tworzenia bardziej wyrafinowanych modeli i aplikacji przetwarzania języka naturalnego.

Wniosek

Program w języku Python korzystający z biblioteki „zestawów danych” Hugging Face z powodzeniem demonstruje połączenie dwóch zbiorów danych z recenzjami filmów IMDb. Ładując podzbiory recenzji pozytywnych i negatywnych, program łączy je w jeden zbiór danych za pomocą funkcji concatenate_datasets(). Następnie przeprowadza prostą analizę, zliczając liczbę pozytywnych i negatywnych recenzji w połączonym zbiorze danych.

Biblioteka „zestawów danych” upraszcza proces obsługi i manipulowania zbiorami danych NLP, czyniąc ją potężnym narzędziem dla badaczy, programistów i praktyków NLP. Dzięki przyjaznemu dla użytkownika interfejsowi i rozbudowanym funkcjonalnościom biblioteka umożliwia łatwe wstępne przetwarzanie, eksplorację i transformację danych. Program przedstawiony w tej dokumentacji stanowi praktyczny przykład wykorzystania biblioteki do usprawnienia zadań związanych z łączeniem i analizą danych.

W rzeczywistych scenariuszach program ten może służyć jako podstawa do bardziej złożonych zadań związanych z przetwarzaniem języka naturalnego, takich jak analiza nastrojów, klasyfikacja tekstu i modelowanie języka. Korzystając z biblioteki „zestawów danych”, badacze i programiści mogą efektywnie zarządzać zbiorami danych na dużą skalę, ułatwiać eksperymentowanie i przyspieszać rozwój najnowocześniejszych modeli NLP. Ogólnie rzecz biorąc, biblioteka „zestawów danych” Hugging Face stanowi istotny atut w dążeniu do postępu w przetwarzaniu i rozumieniu języka naturalnego.