Modele wielkojęzyczne (LLM) to potężny rodzaj algorytmu sieci neuronowej służący do tworzenia chatbotów pobierających dane za pomocą poleceń w językach naturalnych. LLM umożliwiają maszynom/komputerom lepsze zrozumienie języka naturalnego i generowanie języka podobnego do ludzkiego. Moduł LangChain sprawdza się również przy budowie modeli NLP. Nie ma jednak swojego LLM, ale umożliwia interakcję z wieloma różnymi LLM.

Ten przewodnik wyjaśni proces interakcji z dużymi modelami językowymi przy użyciu LangChain.

Jak wchodzić w interakcję z LLM za pomocą LangChain?

Aby komunikować się z LLM za pomocą LangChain, wystarczy postępować zgodnie z tym prostym przewodnikiem krok po kroku z przykładami:

Zainstaluj moduły, aby współdziałać z LLM

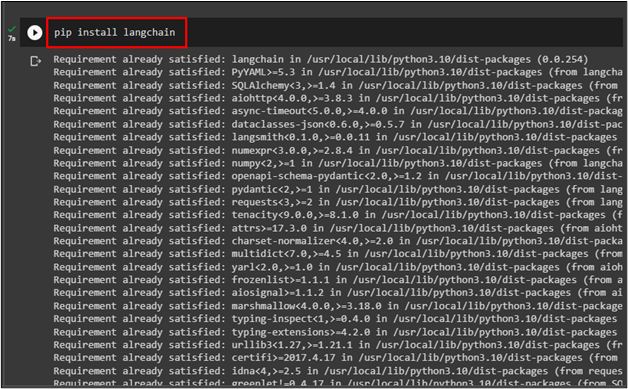

Przed rozpoczęciem procesu interakcji z LLM za pomocą LangChain zainstaluj „ łańcuch językowy ” przy użyciu następującego kodu:

pypeć zainstalować łańcuch językowy

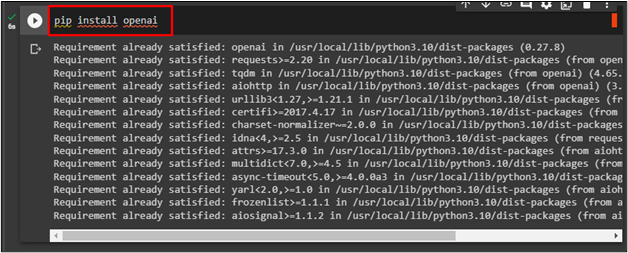

Aby zainstalować framework OpenAI, użyj jego klucza API do interakcji z LLM za pomocą następującego kodu:

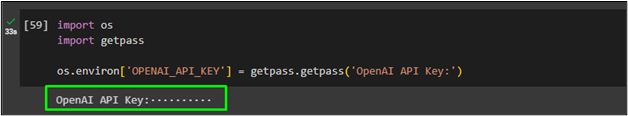

Teraz zaimportuj „ Ty ' I ' przejść dalej ”, aby użyć klucza OpenAI API po wykonaniu kodu:

importuj nas

zaimportuj getpass

os.środowisko [ „OPENAI_API_KEY” ] = getpass.getpass ( „Klucz API OpenAI:” )

Dzwonię do LLM

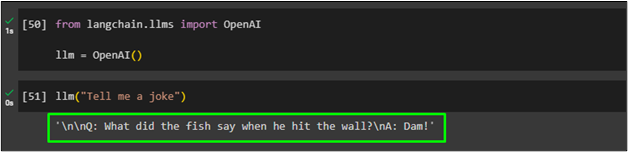

Zaimportuj bibliotekę OpenAI z modułu LangChain, aby przypisać jej funkcję do „ llm ' zmienny:

z langchain.llms importuje OpenAIllm = OpenAI ( )

Następnie po prostu zadzwoń do „ llm ” i zapytanie zachęty jako jej parametr:

Generuj wiele tekstów za pomocą LLM

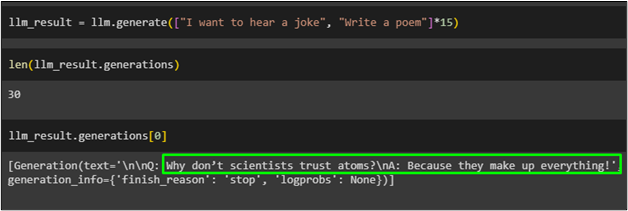

Użyj metody generate() z wieloma podpowiedziami w języku naturalnym, aby wygenerować tekst z LLM i zapisać go w „ llm_result ' zmienny:

llm_result = llm.generate ( [ „Chcę usłyszeć żart” , 'Napisać wiersz' ] * piętnaście )

Uzyskaj długość obiektów przechowywanych w „ llm_result ” zmienna przy użyciu funkcji generate():

Po prostu wywołaj zmienną z numerem indeksu obiektów:

Poniższy zrzut ekranu przedstawia tekst zapisany w „ llm_result ” zmienna o indeksie 0 generująca żart:

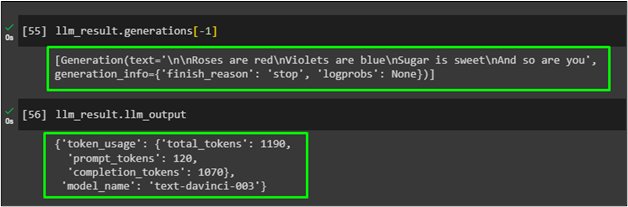

Użyj metody Generations() z parametrem indeks -1, aby wygenerować wiersz umieszczony w zmiennej llm_result:

Po prostu wyświetl wygenerowane dane wyjściowe w zmiennej wynikowej, aby uzyskać informacje specyficzne dla dostawcy, które zostały wygenerowane w poprzednim LLM przy użyciu wygenerowanej funkcji:

Chodzi o interakcję z LLM przy użyciu frameworka LangChain do generowania języka naturalnego.

Wniosek

Aby wchodzić w interakcję z dużymi modelami językowymi za pomocą LangChain, wystarczy zainstalować platformy takie jak LangChain i OpenAI, aby importować biblioteki dla LLM. Następnie podaj klucz API OpenAI, który będzie używany jako LLM do zrozumienia lub wygenerowania języka naturalnego. Użyj LLM jako monitu wejściowego w języku naturalnym, a następnie wywołaj go, aby wygenerować tekst na podstawie polecenia. W tym przewodniku wyjaśniono proces interakcji z dużymi modelami językowymi przy użyciu modułów LangChain.